Einleitung: Der Trugschluss vom „erlaubten KI-Prozentsatz im Studium”

Stell dir vor: Du sitzt in deinem Zimmer, es ist zwei Uhr nachts, und du arbeitest an deiner Bachelorarbeit. Die Prüfungsordnung deiner Uni besagt, dass „bis zu 15% KI-generierte Inhalte” erlaubt sind. Du hast ChatGPT für einige Formulierungen genutzt, alles fein säuberlich dokumentiert, und bist dir sicher, unter dieser magischen 15%-Grenze zu bleiben. Einen Monat später: Deine Arbeit wird beanstandet. Der Vorwurf? Unzulässige KI-Nutzung. Wie kann das sein?

Genau dieses Szenario erlebt gerade eine wachsende Zahl von Studierenden in Deutschland. Sie verlassen sich auf einen erlaubten KI-Prozentsatz im Studium, der ihnen vermeintlich Sicherheit gibt – und stolpern trotzdem über akademische Integritätsregeln. Der Grund? Diese Prozentzahlen sind nicht nur irreführend, sie sind regelrecht gefährlich.

In diesem Artikel decke ich den verborgenen Fehler hinter diesem System auf. Du erfährst, warum sich Universitäten überhaupt auf diese Zahlenspielerei eingelassen haben, wieso sie in der Praxis nicht funktioniert, und – das Wichtigste – worauf es wirklich ankommt, wenn du KI in deiner akademischen Arbeit nutzen willst, ohne Ärger zu bekommen.

Denn hier ist die unbequeme Wahrheit: Der erlaubte KI-Prozentsatz im Studium ist kein Freifahrtschein. Er ist ein Trugbild, das dich in falscher Sicherheit wiegt. Aber keine Sorge – am Ende dieses Artikels wirst du genau wissen, wie du KI richtig und sicher einsetzt.

Was bedeutet „erlaubter KI-Prozentsatz im Studium”?

Kurz & knapp:

Ein „erlaubter KI-Prozentsatz im Studium” bezieht sich auf Richtlinien einiger Hochschulen, die festlegen, welcher Anteil einer Abschlussarbeit durch KI-Tools wie ChatGPT generiert sein darf – häufig zwischen 0% und 20%. Diese Prozentsätze sind jedoch technisch nicht zuverlässig messbar und führen zu Rechtsunsicherheit.

Seit Ende 2022, als ChatGPT die akademische Welt im Sturm eroberte, standen Universitäten vor einer Herausforderung: Wie reguliert man etwas, das man nicht vollständig versteht? Die Antwort vieler Hochschulen war simpel – vielleicht zu simpel: Prozentsätze.

Das Modell ist eingängig: Wenn Plagiatsprüfungen mit Prozentangaben arbeiten können („Ihre Arbeit enthält 8% Übereinstimmungen”), warum dann nicht auch bei KI? So entstanden Regelungen, die besagen, dass beispielsweise „maximal 10% der Arbeit” von KI-Systemen stammen dürfe. Einige Universitäten in Hamburg und München haben solche Klauseln in ihre Prüfungsordnungen aufgenommen, oft mit vagen Formulierungen wie „geringfügige Unterstützung durch KI ist zulässig”.

Der Ursprung liegt in der Analogie zur Plagiatserkennung. Systeme wie Turnitin liefern seit Jahren Ähnlichkeitsquoten, die vermeintlich objektiv messen, ob jemand abgeschrieben hat. Die Logik: Wenn das bei Copy-Paste funktioniert, muss es doch auch bei KI-Texten klappen, oder? Spoiler: Nein.

Verwandte Begriffe, die du in diesem Kontext häufig hörst, sind „KI-Nutzung Uni“, „ChatGPT Hausarbeit Prozent” oder „erlaubter KI-Anteil Abschlussarbeit“. All diese Begriffe kreisen um dieselbe Idee: eine quantifizierbare Grenze für etwas zu ziehen, das sich der Quantifizierung fundamental entzieht.

Doch bevor wir verstehen, warum das nicht funktionieren kann, schauen wir uns an, warum Hochschulen überhaupt zu diesem Mittel greifen.

Warum setzen Hochschulen auf Prozentgrenzen?

Universitäten sind konservative Institutionen – das ist nicht negativ gemeint, sondern strukturell bedingt. Jahrhundertelang basierte akademische Arbeit auf klaren Prinzipien: Du liest Quellen, du denkst nach, du schreibst. Plagiate waren die große Bedrohung, aber auch die waren relativ leicht zu verstehen: jemand kopiert fremde Texte und gibt sie als eigene aus.

Dann kam KI. Und plötzlich war nichts mehr eindeutig.

Die zentrale Angst der Hochschulen ist Qualitäts- und Eigenleistungsverlust. Professoren befürchten, dass Studierende ihre Abschlussarbeiten von ChatGPT schreiben lassen, ohne selbst einen einzigen kritischen Gedanken beizusteuern. Diese Sorge ist nicht unbegründet – wir alle haben Geschichten von komplett KI-generierten Hausarbeiten gehört, die durchgerutscht sind.

Prozentgrenzen wirken wie eine Kontrolllösung. Sie vermitteln das Gefühl, man könne die Situation in den Griff bekommen, indem man sie messbar macht. Es ist psychologisch beruhigend: „Wenn wir 15% erlauben, haben wir die Kontrolle. Mehr als 15%? Dann greift die Sanktion.” Die Zahl schafft eine Illusion von Objektivität und Fairness.

Ein weiterer Grund ist die Übertragung bewährter Methoden. Plagiatssoftware arbeitet mit Prozentsätzen – warum sollte das bei KI anders sein? Das Problem: Plagiatserkennung vergleicht Texte mit existierenden Datenbanken. KI-Detektoren versuchen dagegen, Schreibstile zu erkennen – ein grundlegend anderes, weitaus unzuverlässigeres Unterfangen.

Doch wie sieht das in der deutschen Universitätslandschaft konkret aus? Welche Regeln gelten wirklich?

Wie regulieren Unis aktuell den erlaubten KI-Prozentsatz im Studium?

Die Regulierungslandschaft in Deutschland ist – diplomatisch ausgedrückt – uneinheitlich. Von absoluter Null-Toleranz bis zu großzügigen Experimentierbereichen ist alles dabei. Hier einige Beispiele aus der Praxis:

- Null-Toleranz-Modell: Einige Fakultäten verbieten KI-Nutzung komplett. Jede nachgewiesene Verwendung gilt als Täuschungsversuch. Besonders in juristischen und medizinischen Fakultäten verbreitet.

- Dokumentationspflicht ohne Prozent: Andere Unis erlauben KI, verlangen aber vollständige Offenlegung – ohne konkrete Prozentgrenzen. Du musst angeben, wo und wie du KI genutzt hast.

- Prozent-Vorgaben: Die „15%-Regelung” findet man an einigen Hochschulen in Hamburg und Baden-Württemberg. Die TU München hat ähnliche Richtlinien für bestimmte Fachbereiche erlassen.

- Freie Nutzung mit Einschränkungen: Manche Universitäten erlauben KI explizit als Hilfswerkzeug, verlangen aber, dass die „wesentliche wissenschaftliche Leistung” vom Studierenden kommt – eine bewusst vage Formulierung.

International sieht es ähnlich chaotisch aus. In den USA haben Universitäten wie Stanford und MIT detaillierte KI-Policies entwickelt, die meist auf Transparenz statt Prozentzahlen setzen. Großbritannien diskutiert staatliche Richtlinien, die ein einheitliches Framework schaffen sollen.

Ein kritischer Faktor bei all diesen Regulierungen ist die Rolle von KI-Detektoren. Tools wie GPTZero, Turnitin’s AI Writing Detection oder Copyleaks behaupten, KI-generierte Texte erkennen zu können. Universitäten verlassen sich zunehmend auf diese Software, um die Prozentvorgaben durchzusetzen. Doch hier beginnt das eigentliche Problem – und genau darüber müssen wir jetzt reden.

„Die Idee, KI-Nutzung in Prozenten zu messen, ist wie der Versuch, Kreativität in Kilogramm zu wiegen. Die Kategorie passt einfach nicht zur Sache.”

– Prof. Dr. Anna Weberling, Hochschuldidaktik, Universität Köln

Warum KI-Prozentsätze nicht funktionieren (Die verborgene Wahrheit)

Jetzt kommen wir zum Kern des Problems – dem versteckten Fehler, der das gesamte Prozentsatz-Modell zum Einsturz bringt. Es gibt nicht einen Grund, warum dieses System scheitert. Es sind vier fundamentale Schwachstellen, die zusammenwirken:

Unzuverlässigkeit der Detektoren

KI-Erkennungssoftware produziert erschreckend viele False Positives (sie markiert menschlichen Text als KI) und False Negatives (sie erkennt KI-Text nicht). Studien der Universität Stanford aus 2023 zeigen, dass selbst die besten Detektoren nur eine Genauigkeit von etwa 65-70% erreichen – weniger als ein Münzwurf mit leichter Tendenz.

Besonders problematisch: Nicht-Muttersprachler werden überproportional oft fälschlich markiert. Wenn du als internationaler Student auf Deutsch schreibst und einfachere Satzkonstruktionen verwendest, stuft die Software dich möglicherweise als „KI-verdächtig” ein. Das ist nicht nur technisch fehlerhaft, sondern diskriminierend.

Undefinierbare Graubereiche

Was zählt eigentlich als „KI-generierter Inhalt”? Ist es der Prompt, mit dem du ChatGPT gefüttert hast? Die erste Rohfassung, die die KI ausgespuckt hat? Oder der Text, nachdem du ihn fünfmal überarbeitet, ergänzt und mit eigenen Gedanken angereichert hast?

Beispiel: Du nutzt ChatGPT, um eine Gliederung für deine Arbeit zu erstellen. Du überarbeitest diese Gliederung komplett, füllst sie mit eigener Recherche, schreibst alle Sätze selbst, lässt dann aber einzelne Absätze von der KI „umformulieren”, um sie flüssiger zu machen. Wie viel Prozent KI ist das jetzt? 5%? 30%? 90%? Es ist unmöglich zu sagen.

Quantität ≠ Qualität

Hier kommt die vielleicht wichtigste Einsicht: 5% blind übernommener KI-Text können schädlicher sein als 30% kritisch integrierter KI-Text.

Stell dir vor, du kopierst einen einzigen Absatz aus ChatGPT in deine Arbeit – eine zentrale Definition, die faktisch falsch ist. Das sind vielleicht 3% deiner Arbeit, aber sie untergräbt deine gesamte Argumentation. Im Gegensatz dazu könntest du KI nutzen, um 25 verschiedene Ideen zu generieren, jede davon kritisch prüfen, mit Literatur abgleichen, widerlegen oder bestätigen – und dabei echte wissenschaftliche Arbeit leisten.

Der Prozentsatz sagt nichts über die Qualität der Integration aus. Er misst eine Quantität, die für akademische Integrität völlig irrelevant ist.

Missverständnis von Eigenleistung

Das fundamentale Problem ist, dass „Eigenleistung” im wissenschaftlichen Arbeiten nicht bedeutet, jedes Wort selbst zu tippen. Es bedeutet: eigene Gedanken entwickeln, Quellen kritisch bewerten, Argumente logisch aufbauen, Schlussfolgerungen ziehen.

Du kannst eine Arbeit komplett ohne KI schreiben und trotzdem null Eigenleistung erbringen – indem du einfach paraphrasierend durch Sekundärliteratur stolperst. Umgekehrt kannst du KI intensiv nutzen und trotzdem eine brillante, originelle wissenschaftliche Leistung abliefern – wenn du sie als das einsetzt, was sie ist: ein Werkzeug zur Denkunterstützung, nicht als Denkersatz.

Mehr zu diesem Thema findest du in unserem Artikel „KI nutzen & 100% originell bleiben: Der versteckte Trick”, wo wir genau erklären, wie du die Grenze zwischen Werkzeug und Täuschung ziehst.

Was zählt stattdessen? Die 3 Säulen legitimer KI-Nutzung im Studium

Gut, wenn Prozentsätze nicht funktionieren – was dann? Die Antwort ist weniger sexy als eine klare Zahl, aber dafür tatsächlich umsetzbar. Legitime KI-Nutzung im akademischen Kontext ruht auf drei Säulen:

Transparenz: Offenlegung von KI-Einsätzen

Das Wichtigste zuerst: Sei ehrlich. Wenn du KI genutzt hast, dokumentiere es. Nicht aus Angst, sondern aus wissenschaftlicher Redlichkeit. In den Naturwissenschaften würdest du auch nicht verschweigen, welche Laborgeräte du verwendet hast – warum sollte es bei digitalen Tools anders sein?

Eine gute Dokumentation enthält:

- Welche KI-Tools du verwendet hast (ChatGPT 4, Claude, etc.)

- Für welche Zwecke (Ideensammlung, Gliederung, Sprachkorrektur, Übersetzung)

- An welchen Stellen der Arbeit (z.B. „Kapitel 2.3 – erste Strukturierung”)

- Wie du den Output weiterverarbeitet hast

Eigenleistung: Nachvollziehbare, kritische Auseinandersetzung

Eigenleistung bedeutet nicht „alles selbst getippt”. Es bedeutet intellektueller Mehrwert. Kannst du in einem Gespräch mit deinem Betreuer erklären, warum du zu bestimmten Schlussfolgerungen gekommen bist? Kannst du die Logik deiner Argumentation verteidigen? Verstehst du, was in deiner Arbeit steht?

Dann hast du Eigenleistung erbracht – unabhängig davon, ob du KI für die Formulierung einzelner Passagen genutzt hast.

Quellenintegrität: KI-Output wie Literatur prüfen

Behandle KI-Outputs wie Sekundärliteratur aus einer nicht besonders vertrauenswürdigen Quelle. ChatGPT kann brillant klingen und trotzdem komplett falsch liegen. Jede faktische Aussage, die aus einer KI kommt, muss überprüft werden – am besten mit etablierten wissenschaftlichen Quellen.

Praxisbeispiel: Korrekte KI-Dokumentation

Anhang deiner Bachelorarbeit:

„Im Rahmen dieser Arbeit wurde ChatGPT (Version 4, OpenAI) für folgende Zwecke eingesetzt:

– Kapitel 1: Generierung von drei alternativen Gliederungsvorschlägen, aus denen die finale Struktur entwickelt wurde

– Kapitel 3.2: Erste Formulierung eines Definitionsabsatzes zu ‚agiler Projektführung’, der anschließend mit den Quellen [12], [15] abgeglichen und überarbeitet wurde

– Gesamte Arbeit: Sprachliche Korrektur von Grammatik und Satzbau in einem finalen Durchgang

Alle faktischen Aussagen wurden unabhängig von KI-Vorschlägen durch Fachliteratur verifiziert.”

Diese Art der Dokumentation zeigt Verantwortungsbewusstsein. Sie zeigt, dass du KI als Werkzeug verstehst, nicht als Abkürzung. Und sie gibt Gutachtern die Sicherheit, dass die wissenschaftliche Qualität deiner Arbeit nicht auf blindem Vertrauen in eine Maschine beruht.

Für eine tiefere Auseinandersetzung mit plagiatsfreiem Arbeiten trotz KI-Nutzung empfehle ich unseren Artikel „Plagiatsfreie Texte mit KI erstellen: 7 Geheimnisse 2024″.

So gelingt erlaubte KI-Nutzung in der Praxis

Theorie ist schön und gut, aber du brauchst einen praktischen Workflow, der dich sicher durch deine Abschlussarbeit bringt. Hier ist mein 4-Schritte-Plan, der funktioniert – egal, wie unklar die Regeln deiner Uni sind:

Schritt 1: Prüfungsordnung akribisch prüfen

Lies deine Prüfungsordnung nicht nur oberflächlich. Suche nach Begriffen wie „KI”, „künstliche Intelligenz”, „digitale Hilfsmittel”, „Eigenständigkeitserklärung”. Wenn deine Uni schweigt, frag nach – schriftlich, per E-Mail, damit du es dokumentiert hast. Ein „Ich wusste nicht, dass es verboten ist” schützt nicht, aber ein „Ich habe am XX.XX. nachgefragt und keine Antwort erhalten” schon eher.

Schritt 2: Dokumentation von Anfang an

Führe ein KI-Logbuch. Das klingt aufwendig, dauert aber nur wenige Minuten pro Woche. Notiere jeden KI-Einsatz: Datum, Tool, Zweck, betroffener Abschnitt. Am Ende deiner Arbeit fasst du das in einem Anhang zusammen. Diese Transparenz ist deine beste Versicherung gegen Missverständnisse.

Schritt 3: Kritischer Einsatz statt blindes Kopieren

Nutze KI als Sparringspartner, nicht als Ghostwriter. Gute Anwendungsfälle:

- Brainstorming von Argumentationslinien

- Vereinfachung komplexer Fachtexte zum besseren Verständnis

- Übersetzung fremdsprachiger Quellen als erste Orientierung

- Formulierungsalternativen bei sprachlichen Unsicherheiten

- Prüfung der Logik deiner Argumentation (als Testleser)

Schlechte Anwendungsfälle:

- „Schreibe mir Kapitel 3″

- Faktenrecherche ohne Gegenprüfung

- Generierung von Literaturangaben (KI erfindet oft Quellen!)

- Kopieren ganzer Absätze ohne kritische Prüfung

Schritt 4: Nachweis der Eigenleistung vorbereiten

Sei bereit, deine Arbeit zu verteidigen. Das bedeutet nicht unbedingt eine mündliche Prüfung, aber du solltest jederzeit erklären können: Was ist meine These? Warum habe ich sie so begründet? Welche Alternativerklärungen habe ich erwogen und warum verworfen? Wenn du diese Fragen beantworten kannst, hast du bewiesen, dass die Arbeit aus deinem Kopf kommt – nicht aus einer KI.

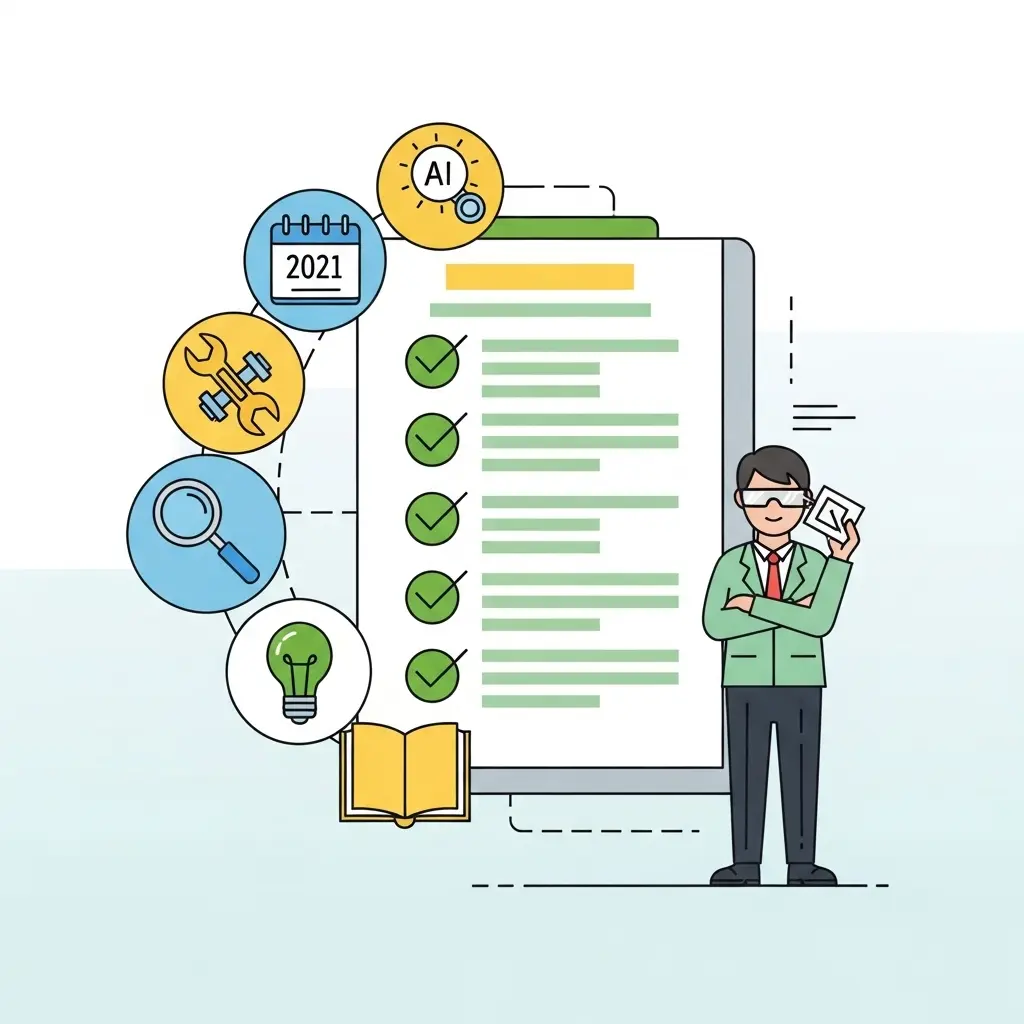

✓ Checkliste: 7 Fragen vor der Abgabe

- Habe ich alle KI-Einsätze dokumentiert?

- Kann ich jede Hauptthese meiner Arbeit aus dem Kopf erklären?

- Habe ich alle KI-generierten Fakten mit echten Quellen verifiziert?

- Stimmt meine Eigenständigkeitserklärung mit meinem tatsächlichen Vorgehen überein?

- Würde meine Arbeit eine KI-Detektionsprüfung überstehen – und wenn nicht, kann ich erklären warum?

- Habe ich mich mit den spezifischen KI-Regeln meines Fachbereichs vertraut gemacht?

- Bin ich stolz auf diese Arbeit als Ausdruck meiner wissenschaftlichen Kompetenz?

Wenn du alle 7 Fragen mit „Ja” beantworten kannst, bist du auf der sicheren Seite.

Übrigens: Hochschulen schützen nicht den Prozess des Tippens, sondern die Entwicklung von Kompetenzen – kritisches Denken, wissenschaftliches Argumentieren, methodisches Vorgehen. Wenn deine KI-Nutzung diese Kompetenzen unterstützt statt ersetzt, bewegst du dich in einem legitimen Rahmen.

Zukunftsausblick: Wohin entwickeln sich die Regelungen?

Die aktuellen Regelungen sind Übergangslösungen – das ist allen klar. Aber wohin entwickelt sich das System? Basierend auf internationalen Trends und Expertenmeinungen zeichnen sich drei Phasen ab:

Kurzfristig (2024-2025): Uneinigkeit und Experimente

Die nächsten zwei Jahre bleiben chaotisch. Unis werden verschiedene Ansätze testen, manche davon werden scheitern, andere sich durchsetzen. Studierende müssen in dieser Phase besonders wachsam sein und sich aktiv informieren.

Mittelfristig (2026-2028): Konvergenz zu Best Practices

Wahrscheinlich wird sich ein Transparenz-basiertes Modell durchsetzen, das nicht mit Prozentzahlen arbeitet, sondern mit klaren Dokumentationspflichten und Kompetenznachweisen. Ähnlich wie bei Open-Book-Prüfungen wird der Fokus auf dem „Wie” statt dem „Was” liegen.

Langfristig (ab 2029): Integration statt Regulierung

KI wird vermutlich so selbstverständlich wie Taschenrechner oder Textverarbeitung werden. Die Frage wird nicht mehr sein „Darf ich KI nutzen?”, sondern „Wie nutze ich sie kompetent?” Prüfungen werden sich anpassen – weg von reiner Wissensabfrage, hin zu kritischem Denken, Problemlösung und kreativer Anwendung.

Bis dahin gilt: Bleib informiert, bleib transparent, bleib kritisch. Die Prozentzahlen sind ein Irrtum, aber deine akademische Integrität ist es nicht.

Lascia un commento